说实话,这句话的分量,比整个访谈里其他所有内容加起来都重。

Suleyman 不是那种喜欢放卫星的人,DeepMind 联合创始人,后来做 Inflection AI,现在掌微软 AI,这个人的底色是研究者,不是推销员,他说「近在咫尺」的时候,我是真的觉得,他不是在画饼。

但「还需要2-3个重大技术突破」这句话,才是真正值得掰开揉碎了看的地方。

到底是什么突破?

从哪里突破?

为什么是2-3个,不是10个,也不是1个?

坦率的讲,以下这些是我自己的判断,不一定对,但我认真的想了几天,也跟几个做技术的朋友聊了聊。

先说说 Suleyman 这次到底说了什么。

他把 AI 的发展分成了三个层次,这个分类方式我自己觉得还挺清晰的。

第一层叫 AGI,通用人工智能,定义是 AI 可以在绝大多数任务上达到人类水平,注意,是绝大多数,不是全部,这块其实现在的 GPT-4o、Claude Opus 4.6、Gemini 这些,已经在很多任务上摸到了人类水平,有些甚至超了。

第二层叫超级智能,这个就不只是「达到人类」了,而是「全面超越」,而且还能自主发现训练数据之外的新知识,比如发明新分子、新材料,这块,Suleyman 的原话是「近在咫尺」。

第三层叫奇点,就是 AI 可以递归自我迭代,能力指数爆炸,这块,Suleyman 说的很直接,这属于科幻,还很远。

所以他说「超级智能近在咫尺」,指的不是奇点,而是第二层,超级智能。

但「近在咫尺」不等于「已经到了」,他说还需要2-3个重大技术突破,这句话才是重点。

那我来试着说说,这2-3个突破,可能在哪里。

第一个,也是最明显的,推理能力的质变。

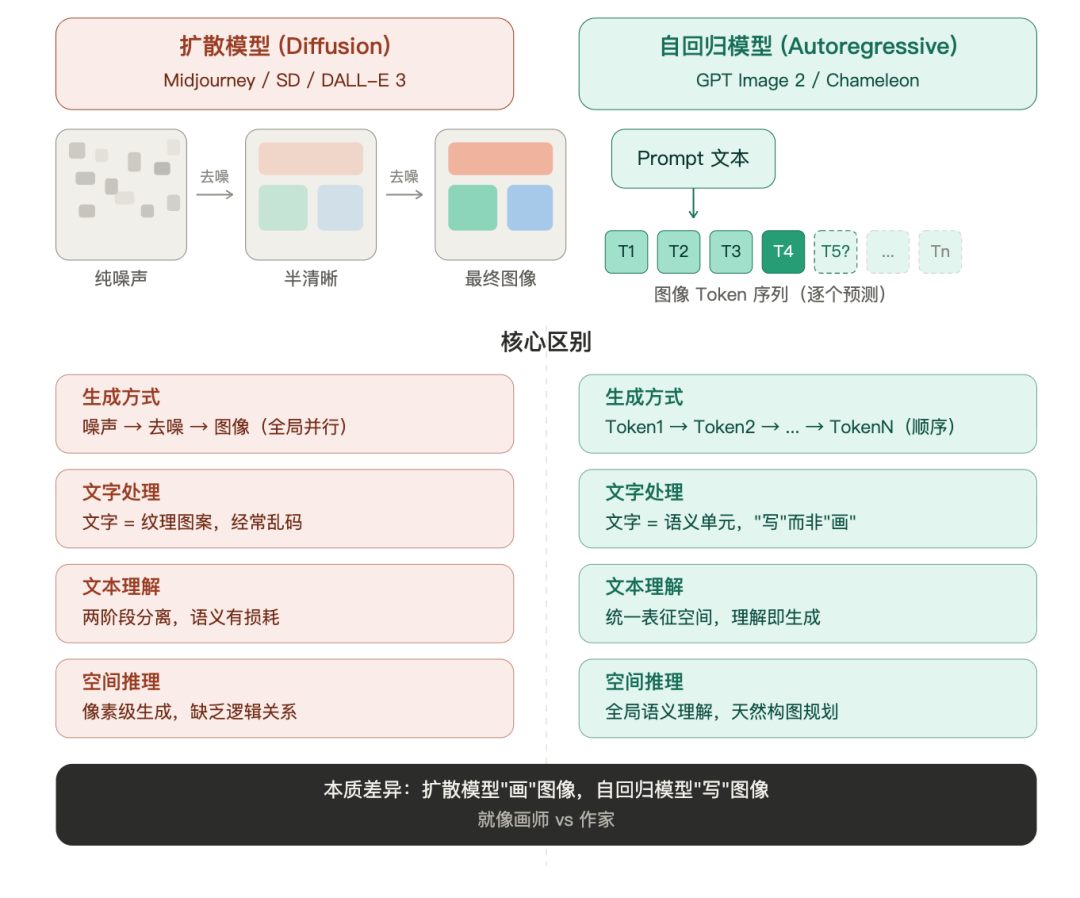

现在的大模型,核心都在做同一件事,给定上文,预测下一个 token,这个范式厉害的地方是,它通过巨量的数据压缩,学到了人类知识的统计规律,但它有一个天花板,做的事其实是统计层面的模式匹配,而不是真正的推理。

等下。

我刚才这句话,其实说的还不够准。

说它是「模式匹配」,听起来像是在贬低它,但这不是贬低,这是一个事实描述,它的所有能力,都来自训练数据里出现过的统计规律,它没有「跳出数据去想新东西」的能力。

这个差别,说实话,是天壤之别。

你可以把它想象成一个看了所有围棋棋谱的人,他下的每一步,都是基于见过的对局,但如果棋盘上出现了一个完全新的局面,一个人类棋手可以靠「直觉」和「创造力」想出新招,但模型只能靠统计概率选一个「最像对的」下一步。

现在的 o1、o3 这些「思维链」模型,是在试图突破这个天花板,但它们的方法,本质上还是靠「更长的生成」来模拟推理,不是真正的、内生性的推理能力。

真正的突破,需要模型具备「在生成之前,先在思维空间里做搜索和回溯」的能力,而不是一条路走到黑。

这块,Suleyman 说微软的新模型(MAI 系列)明确不做蒸馏,要自研全栈,背后的逻辑就是,只有自己从头构建了推理能力,才能真正突破天花板,而不是永远跟在别人后面。

第二个突破,世界模型。

这个词最近提的人挺多的,但真正做到的,几乎没有。

现在的大模型,对世界的理解是「统计相关性」,不是「因果性」,也不是「物理规律」。

举个例子,你告诉一个大模型「杯子从桌子上掉下去了」,它会生成「杯子碎了」或者「水洒了」,因为它在训练数据里见过这个搭配,但它并不理解「重力」「惯性」「脆性」这些物理概念。

要让 AI 真正「理解」世界,需要的不是更多的文本数据,而是多模态的、具身的交互数据,是「行动→观察结果→修正模型」这个闭环。

这块为什么重要?

因为超级智能的定义里,有一条是「自主发现训练数据之外的新知识」,如果 AI 没有世界模型,它永远只能「复述」人类已经知道的东西,不能「发明」人类还不知道的东西。

第三个突破,持续学习,或者说「终身学习」能力。

现在每一个大模型,都是「训练完就死了」,它不能持续学习,不能积累经验,每一次都是从头开始。

人类智能的核心,恰恰是「从出生到死亡,一直在学习,一直在更新自己的模型」。

如果 AI 做不到这一点,它永远是一个「工具」,不是一个「智能体」。

但持续学习的难点在于,模型会「灾难性遗忘」,新学的东西会覆盖掉旧的知识,这个问题,研究了二三十年,一直没有好的解决方案。

Suleyman 说还需要2-3个突破,我猜,持续学习一定是其中之一。

第四个,数据瓶颈。

这个已经是个公开秘密了,高质量的文本训练数据,快用完了。

下一步怎么办?

一条路是「合成数据」,用模型生成数据来训练模型,但这条路有「模型坍塌」的风险,就是模型越来越差,因为你在用「近似值」训练「近似值」。

另一条路是「推理时计算」,就是不让模型在训练时学会所有东西,而是让它在回答问题的时候,现场「想」一会儿,o1 就是这个思路。

还有一条路,是「从交互中学习」,不让模型靠离线数据训练,而是让它在真实世界里的交互中不断积累经验,这条路最难,但也最像人类的学习方式。

第五个,能量效率。

这个可能是最容易被忽视,但其实最硬的瓶颈。

人脑运行功率大概是 20W,GPT-4 训练一次消耗的算力,换算成能量,是天文数字。

如果超级智能需要指数级更多的算力和能量,那它永远不会真正到来,因为能源和芯片的供给是有物理上限的。

所以,真正的突破,可能不是「把模型做得更大」,而是「把模型做得更高效」。

稀疏激活、量化、专用芯片架构,这些方向,可能比单纯堆参数更重要。

聊完技术,说一个更宏观的事。

Suleyman 在访谈里提到,微软和 OpenAI 的合作, originally 是「OpenAI 做研究,微软做产品」,但现在,OpenAI 也在做全栈(产品、数据中心、芯片),微软也在自研模型。

所以2025年10月,双方签了一个新的协议,微软可以独立研发超级智能。

这个转向,说实话,我挺认同的。

AI 这种东西,它不应该被任何一家公司完全控制,不管是微软、OpenAI、还是谷歌。

超级智能如果出现,它应该是全人类的资产,而不是某几家公司的利润中心。

Suleyman 至少在公开场合表达了类似的意思,他说 AI 应该让所有人更健康、更聪明、更快乐。

这话听着像公关,但如果你了解他的背景,他在 DeepMind 的时候就一直在推「AI for Science」,用 AI 加速科学发现,所以这个人可能不是单纯在说漂亮话。

但话说回来,理想主义和商业利益之间的张力,永远存在,这一点,我有时候觉得,可能比技术突破本身还难解。